Tekniken har utvecklats till den punkt där vi nu har artificiell intelligens som kan skriva fantastiska uppsatser. AI-skrivna uppsatser visar sig vara exceptionella i kvalitet och förvånansvärt mänskliga i nästan alla aspekter. Det mest slående med dessa AI-drivna uppsatsgeneratorer är att de kan producera förstklassiga uppsatser på några minuter!

Det är helt naturligt för oss människor att undra hur artificiell intelligens kan göra det. När allt kommer omkring, är inte människan den mest intelligenta varelsen på jorden? Om du är student och vill få din uppsats skriven med Hjälp på nätet från experter, du skulle vilja veta hur en maskin skriver bättre än du, skulle inte du?

Generativ AI är den kategori av AI som kan producera uppsatser, bloggar och annat skriftligt innehåll på ett ögonblick. Det finns flera generativa AI-modeller, men en av de mest kända OCH kraftfullaste är GPT. GPT, eller Generative Pre-trained Transformer, är en djupinlärande modell för neurala nätverk som blev känd 2022 tack vare sin användarvänlighet och häpnadsväckande kapacitet. Otroligt kraftfulla, GPT-baserade verktyg och plattformar genererar fantastiska uppsatser, analysera litteratur, skriva program, lösa matematiska problem och mycket mer.

I den här artikeln beskrivs de processer som gör GPT till en så kraftfull uppsats- och innehållsgenerator.

Vad är GPT?

GPT är en generativ AI som för närvarande är den mest populära förespråkaren inom området för generering av naturliga språk. GPT är en akronym för Generative Pre-trained Transformers och använder djupinlärda neurala nätverk för att förstå och bearbeta data för att generera innehåll på naturliga språk.

För att förstå hur det går till måste vi titta närmare på de tekniska detaljerna.

-

Generering av naturligt språk

Natural Language Generation (NLG) är en undergren till Natural Language Processing, en gren inom AI och datorlingvistik som sysslar med naturliga mänskliga språk. NLG fokuserar på att generera naturligt innehåll på mänskligt språk. Området är också en delmängd av generativ AI, en typ av teknik som handlar om att utforma och utveckla AI-system som kan skapa innehåll som uppsatser, bloggar, bilder, matematiska lösningar, datorprogram etc.

-

Neurala nätverk

Som namnet antyder är neurala eller artificiella neurala nätverk ryggraden i djupinlärningsalgoritmer. Deep learning är ett delområde inom maskininlärning som använder neurala nätverk för att efterlikna mänskliga hjärnor och neurala signaler.

Neurala nätverk är mycket mer kapabla än algoritmer och metoder för maskininlärning. Två viktiga egenskaper hos neurala nätverk är automatiserad extrahering av funktioner från data och förmågan att hantera stora datamängder. Generativa förtränade transformatorer är speciella neurala nätverkssystem som kan analysera och generera innehåll baserat på den typ av data de tränas på.

Transformers är specialdesignade neurala nätverk som kan avgöra sammanhang utifrån indata och identifiera underliggande samband i sekventiella eller andra datamönster. Med rätt träning kan transformers neurala nätverk skriva vilken uppsats som helst om vilket ämne som helst, lösa otroligt komplexa matematik- och datorprogram, trolla fram bloggar och mycket mer.

Inte undra på att Internet svämmar över av omnämnanden av GPT, GPT-3, GPT-4 och Chat GPT.

ChatGPT har varit flaggskeppet för AI-spridningen under de senaste åren. Enligt Reutershar Chat GPT satt rekordet för den snabbast växande användarbasen bland alla up & coming mjukvaruplattformar. GPT är också den motor som driver innehållsgenererande onlineapplikationer som Jasper AI, Quillbot och ContentBot.

Men hur exakt efterliknar transformatorns neurala nätverk mänskligt skrivande?

Hur genererar GPT fantastiska uppsatser?

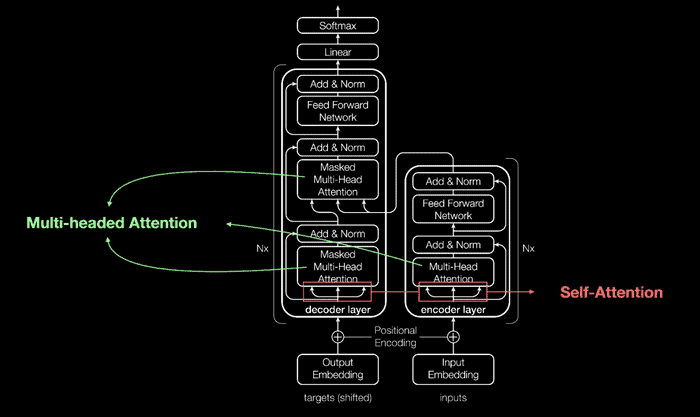

Neurala nätverksmodeller för transformatorer består av en neuralt nätverksstack med flera lager.

- Som nämnts är transformatorer specialiserade neurala nätverk som kan förstå sammanhang, relationer och ämnen i alla data som de arbetar med. Dessa nätverk använder en avancerad och ständigt utvecklande uppsättning matematiska och statistiska tekniker som kallas självuppmärksamhet att analysera och upptäcka olika dataparametrar.

- Transformers är tillräckligt kraftfulla för att identifiera relationer mellan avlägsna element i en dataström och hur de relaterar till och påverkar varandra.

- I uppsatser och liknande språkbaserat innehåll representerar ord data. Transformers i GPT kan avgöra hur ord associerar med varandra, hur de relaterar till andra ord eller ordkedjor (meningar och stycken), och vilken effekt de har på andra aspekter av texten.

Nedan visas hur en modell av ett neuralt nätverk för transformatorer ser ut.

Källa: www.nvidia.com

Till höger visas transformatorns kodardel. Den går igenom ett själv-multiheaded uppmärksamhetsunderskikt och ett Feed-Forward Network-underskikt. Den högra sidan är avkodarsidan, som har två flerhövdade uppmärksamhetsunderlager och ett neuralt nätverk för feed-forward.

Uppmärksamhetsmekanismen utför en ord-till-ord-operation. Det innebär att systemet interagerar med indata i sekvens och bestämmer vilka indata som ska prioriteras. Genom att göra detta bestämmer GPT substantiv och namngivna enheter, kontexter, begrepp och ämnen. När du anger en uppsatsfråga i ett GPT-baserat verktyg dissekerar och analyserar det varje ord som rör det andra med hjälp av självuppmärksamhetsmekanismen.

Här är ett exempel som förklarar grunderna.

Han fortsatte att hälla vatten från tanken till poolen tills den var full.

När denna mening matas in taggar positionskodarna de olika typerna av ord. Taggarna bestämmer syftet med orden, och självuppmärksamhetsmekanismen följer dessa taggar för att köra vektorpunktsproduktoperationer mellan alla ordvektorer. På så sätt hittar den de starkaste relationerna mellan alla ord.

Han fortsatte att hälla vatten från tanken till poolen tills den var tom.

I båda meningarna används ordet den hänvisar till och betyder olika saker. Transformers dechiffrerar dessa kontextuella betydelser för att lära sig relationer mellan ord. Detta ÄR den grundläggande idén bakom transformers och GPT-arkitekturen. Ord taggas och deras betydelse, relationer och påverkan fastställs för att dechiffrera sammanhang och övergripande betydelse.

Transformerande neurala nätverk använder linjär algebra, kalkyl, sannolikhet, talteori och statistik för att omvandla naturliga språkrepresentationer och göra dem lämpliga för manipulation. Om du vill fördjupa dig ytterligare i dem bör du fräscha upp dina kunskaper i matematik, statistik och lingvistik.

På det sista benet i den här artikeln, låt oss ta en snabb titt på tre av de mest populära GPT-drivna AI-uppsatsskrivningsverktygen.

3 Bästa AI-uppsatsförfattare som använder GPT

-

Rytr

Rytr är den mest exakta GPT-3-drivna innehållsgeneratorn och är AI-assistenten som kan hjälpa dig att skriva vad som helst. Du kan generera högkvalitativt innehåll med denna plattform med uppsatser, bloggar, e-post, marknadsföringskopior och avhandlingar.

Prissättningsplanerna är ganska överkomliga och börjar från $9 per månad. Det finns till och med en GRATIS plan som låter dig generera 10000 tecken varje månad.

-

Jasper AI

Jasper AI är ett av de mest populära AI-skrivverktygen på webben och kan skriva uppsatser och parafrasera text. Den kontrollerar också grammatik och plagiering. Alla dessa funktioner kommer dock till ett högt pris på $39 per månad.

-

Textero AI

En annan förstklassig plattform för att generera uppsatser gratis, Textero är ett bra val för studenter. Även om det kan generera bra innehåll, genererar det bara förstklassigt innehåll när du utnyttjar premiumversionen. Det genererade innehållet har ofta problem med formatering, ordval, integritet och mekaniska problem.

Med det avslutar vi den här sammanfattningen. Hoppas att detta var en intressant läsning. Om GPT, generativ AI och NLG intresserar dig eller om du vill skapa din egen AI-essäförfattare, anmäl dig till en online AI-kurs idag.